导读 Introduction

近日,中央全面深化改革委员会第二十六次会议审议通过了《关于构建数据基础制度更好发挥数据要素作用的意见》。

会议强调,数据基础制度建设事关国家发展和安全大局,要维护国家数据安全,保护个人信息和商业秘密,促进数据高效流通使用、赋能实体经济,统筹推进数据产权、流通交易、收益分配、安全治理,加快构建数据基础制度体系。

数据作为全新生产要素,其独特性决定了只有实现安全可信流通,才能充分释放价值潜能。

一、数据要素流通面临数据安全问题

时代背景

近年来,数字经济蓬勃发展,已经成为带动中国经济增长的核心动力。2020年4月,中共中央国务院发布了《关于构建更加完善的要素市场化配置体制机制的意见》,首次将数据与土地、劳动力、资本、技术等传统要素并列为生产要素。2021年12月,中国人民银行发布《金融科技发展规划(2022—2025年)》明确提出从强化数据能力建设、推动数据有序共享、深化数据综合应用、做好数据安全保护方面充分释放数据要素潜能。数字经济时代,数据成为新的关键生产要素,成为了社会基础性战略资源,蕴藏着巨大潜力和能量。

数据作为全新生产要素,其所具有的外部性、非结构性、非标准化、资源标的多变性、边际成本递减、规模报酬递增等特征,使得数据的权属界定、价格形成、交易流通、开发利用等各个环节均存在诸多待解决的问题和挑战。从经济特征看,数据具有独特的生产成本结构,即初始生产的固定成本高、此后以复制和优化为主要技术手段的再生产成本非常低,且数据质量不易损耗。这些特性直接决定了只有解决数据安全和隐私保护问题,数据要素价值才能够有效体现,数据要素市场才得以健康发展。

政策法规

目前全球多个国家和地区制定了数据保护方面的政策法规,并建立了国家数据保护机构或相关监管机构。举例如下:

国外数据安全政策

2007 年出台的《欧盟基本权利宪章》(European Charter of Fundamental Rights)明确将个人数据保护作为基本权利,为数据主体有效行使权利提供了法律基础。

欧盟于2018年起正式生效《通用数据保护条例》(General Data Protection Regulation, GDPR),强化了对遗忘权、删除权的要求。

2018 年,英国推出 《数据保护法案 2018 》(Data Protection Act 2018,DPA2018),DPA2018 中描述了同 GDPR 的关系,并于 2020 年 12 月 31 日将该部分调整为 UK GDPR。DPA2018 对个人数据的处理作出了规定,并明确大部分个人数据的处理受 UK GDPR 约束。

2018 年 6 月及 2020 年 11 月,加利福尼亚州分别通过了《加州消费者隐私法案》(California Consumer Privacy Act,CCPA)及《加州隐私法案》(California Privacy Rights Act,CPRA)。该法案是美国第一部全面隐私法,要求收集、使用、传输和出售个人信息的受管制公司履行一系列义务,以保障加州消费者的隐私权利。

2021年 7 月,美国统一法律委员会(ULC)投票通过了《统一个人数据保护法案》,为各州提供了数据隐私法案范本。

国内数据安全政策

2021 年 1 月 1 日起施行的《中华人民共和国民法典》为个人信息保护提供了基础依托。该法典在总则中明确了自然人的个人信息受法律保护。任何组织或者个人需要获取他人个人信息的,应当依法取得并确保信息安全,不得非法收集、使用、加工、传输他人个人信息,不得非法买卖、提供或者公开他人个人信息。

2021年9月正式实施的《中华人民共和国数据安全法》将“促进数据开发利用”作为立法目的之一。该法对数据处理的概念进行了定义,包括数据的收集、存储、使用、加工、传输、提供、公开等。

2021年11月1日实行的《中华人民共和国个人信息保护法》从个人信息处理规则、个人信息跨境提供的规则、个人在个人信息处理活动中的权利、个人信息处理者的义务、履行个人信息保护职责的部门等多个层面进行设计,为个人信息提供了高标准保护。

中央网信办、工业和信息化部、公安部、市场监管总局四部门联合发布的《关于开展App违法违规收集使用个人信息专选治理的公告》规范了个人信息采集等方面的做法。

地方政府也陆续出台了大数据或公共(政务)数据方面的条例、管理办法等文件。

二、隐私计算技术实现数据安全流通

隐私计算是面向隐私信息全生命周期保护的计算理论和方法,是隐私信息的所有权、管理权和使用权分离时隐私度量、隐私保护与隐私分析复杂性的可计算模型与公理化系统。具体是指在处理视频、音频、图像、图形、文字、数值、泛在网络行为信息流等信息时,对所涉及的隐私信息进行描述、度量、评价和融合等操作,形成一套符号化、公式化且具有量化评价标准的隐私计算理论、算法及应用技术,支持多系统融合的隐私信息保护。

隐私计算技术的应用具有重要意义,一是隐私计算具备原始数据不出域、计算过程加密、不共享明文数据等优势,可有效保障数据安全和用户隐私;二是基于合法合规的数据利用,打破数据壁垒,赋能多方协作,驱动业务创新;三是通过分离数据所有权与使用权,不交易数据本身,只交易数据的计算结果,让数据交易与价值核算合理化。

隐私计算主要的技术方案分为三种:多方安全计算、联邦学习、可信执行环境。

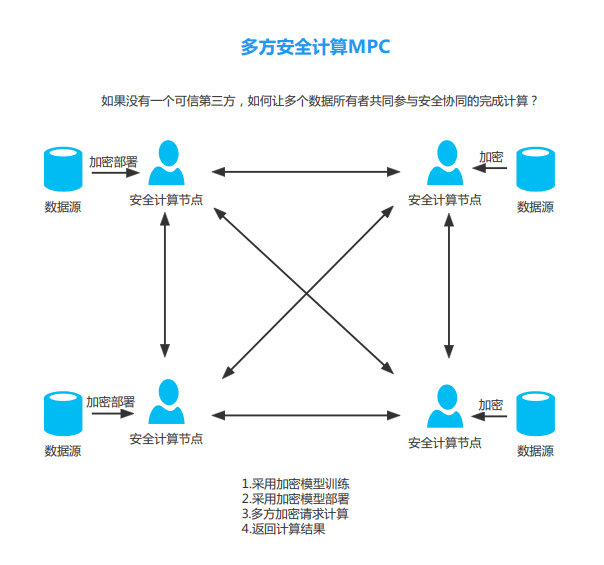

多方安全计算(MPC)

以密码学为核心

提出:由姚期智院士于1982年提出。

定义:多方安全计算(MPC)可以保障多个参与方进行协同计算并输出计算结果的同时,使各个参与方除了计算结果之外无法获取任何其他信息,从技术层面实现数据的可用不可见。

实现方案:主要包括同态加密 (Homomorphic Encryption,HE)、不经意传输 (Oblivious Transfer, OT)、混淆电路(Garbled Circuit, GC)、秘密共享 (Secret Sharing, SS) 等。

联邦学习(FL)

融合隐私保护技术的联合建模

提出:由Google于2016年提出。

定义:联邦学习(FL)旨在建立一个基于分布数据集的联邦学习模型,是一种在原始数据不出库的情况下,协同完成机器学习任务的学习模式。在联邦学习实践中还需要融合各类隐私保护技术对传输信息实现进一步的保护,来构建可信联邦学习(TFL)能力。

应用场景:横向联邦学习、纵向联邦学习 、联邦迁移学习。

可信执行环境(TEE)

依托可信硬件的技术

定义:可信执行环境(TEE)是通过可信、抗篡改的软硬件构建一个可信的安全环境。在硬件中为敏感数据单独分配一块隔离的内存,所有敏感数据均在这块内存中展开计算,并且除了经过授权的接口外,硬件中的其他部分不能访问这块隔离内存中的信息。数据在该环境中由可信程序进行处理,以此来保护程序代码或者数据不被操作系统或者其他应用程序窃取或篡改。

三、跨隐私计算平台互联互通仍待攻克

从当前国内外隐私计算整体市场发展现状来看,各类行业机构如银行、运营商等体系均已陆续引入隐私计算技术,并部署相关系统。但各类数据应用方和数据提供方往往部署着不同的隐私计算平台,当前隐私计算厂商研发的平台大多为异构闭源平台,技术实现原理差异较大,造成跨平台无法互联互通。隐私计算旨在连接“数据孤岛”,却演变成“计算孤岛”,给部署不同系统的机构带来“维护成本高、数据跨平台流通难”的问题。此外,由于部分机构部署的第三方隐私计算平台乃闭源实现,随着合作平台数量增加,系统的安全监管也将面临巨大挑战。

如何安全、合规、高效地实现不同隐私计算平台的互联互通,已成为各数据应用行业接下来需要重点攻克的阿喀琉斯之踵。

来源:Open Islands