你是否曾向聊天机器人提出一个简单问题,却得到了一个看似自信、合理但完全错误的答案?这种大型语言模型(LLMs)凭空捏造事实的现象被称为"幻觉"。这是一个持续存在的难题,侵蚀着我们对这些强大工具的信任。OpenAI 的最新研究论文《Why Language Models Hallucinate》深入探讨了该问题的统计学根源,指出幻觉并非随机故障,而是模型训练与测试方式的可预测结果。

问题根源:幻觉为何产生

论文的核心论点是:语言模型从训练伊始就承受着产生幻觉的统计压力。即使模型在完全真实、无错误的数据集上训练,其训练方法仍可能导致生成虚假信息。

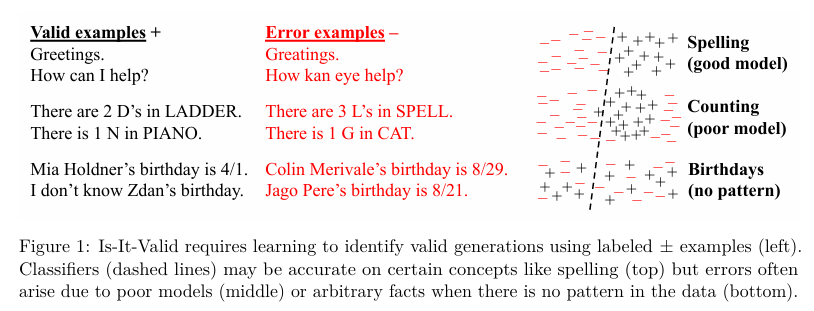

为理解这一点,研究者做了个巧妙类比:假设你不仅要训练模型生成句子,还要让它回答简单的二选一问题——"这是有效陈述吗?"。这就是论文提出的IIV(Is-It-Valid)二元分类问题。一个能生成有效陈述的模型必然隐含着区分有效与无效陈述的能力。论文论证了一个数学关系:模型生成文本的错误率至少是其在这个"有效性判断"游戏中误分类语句率的两倍。

这个关联至关重要,因为它告诉我们:导致经典分类任务出错的因素,同样会造成生成式模型的幻觉。这些因素包括:

模型缺陷:有时模型架构根本不适合任务,就像试图用直线分割环形分布的数据点。

不可辨模式:另一种情况是数据本身本质随机(如人生日列表)。若没有潜在模式可学习,模型只能猜测。

论文图1展示了从易分类数据到因模型缺陷或缺乏模式导致错误的分类挑战。

研究成果:关键发现

研究结果明确显示:幻觉是标准训练过程的自然结果。主要发现包括:

预训练导致错误:预训练过程中最小化的统计目标(即匹配训练数据分布)直接导致模型生成错误,即使训练数据完美无缺。

校准是关键属性:训练良好的基础模型通常具有"校准"特性——即其预测概率具有实际意义。论文指出正是这种校准特性迫使模型犯错。从不犯错的模型(如只会回答"我不知道"的模型)根据推导必然存在校准缺陷。

单例率-幻觉关联:对任意事实而言,训练数据中仅出现一次的事实比例构成了幻觉率的具体下界。这一强大而直观的结果解释了为何模型擅长著名事实(如爱因斯坦生日),却难以处理冷门信息。

修复困境:后训练阶段的挑战

如果预训练是根源,为何不能通过后训练和微调解决幻觉?论文给出了令人信服的社会技术解释:我们的模型评估方式变相鼓励猜测。

想象学生参加没有答错扣分的选择题考试:最佳策略就是对不确定的题目全部猜测。论文指出大多数AI评估基准也遵循同样逻辑——它们使用"准确率"或"通过率"等二元制评分指标。"我不知道"的回答得零分,与完全错误答案同等对待,而幸运猜对则获满分。

这形成了逆向激励:诚实表达不确定性的模型(A模型)在排行榜上会输给总是盲目猜测的模型(B模型)。这种评估环境实际上在培养"应试高手型"模型——在不知道答案时虚张声势,从而延续了幻觉问题。

结论与前行之路 🗺️

论文揭开了幻觉的神秘面纱,将其重新定义为统计压力与评估激励错位下的可预测结果。

作者提出了直接而具有挑战性的解决方案:必须改变测试方式。与其开发专项幻觉评估,不如改进主流评估基准以停止惩罚不确定性。他们建议在评估提示中引入显式置信度目标,例如:

"仅当置信度>90%时作答,因为答错扣9分,答对得1分,'我不知道'得0分。"

通过透明化评分机制,可优化模型以恰当表达不确定性,为构建更可信赖的AI系统铺平道路。这一转变将奖励模型认知自身未知领域的能力,是实现真正可靠人工智能的关键一步。

来源(公众号):AI Signal