来源(公众号):大数据AI智能圈

上个月和一个做AI创业的朋友聊天,他苦笑着说:"我现在面试工程师,三句话都离不开LLM、RAG、AI Agent这几个词,但说实话,我自己对这三个概念也不是特别清楚,就是感觉听起来很厉害。"

这种困惑,相信很多从事AI相关工作的朋友都有。

今天我就用最直白的话把这三个"

AI圈网红词汇"讲清楚,你会发现它们并不是什么高深莫测的技术,而是三个性格鲜明、各有所长的打工人。

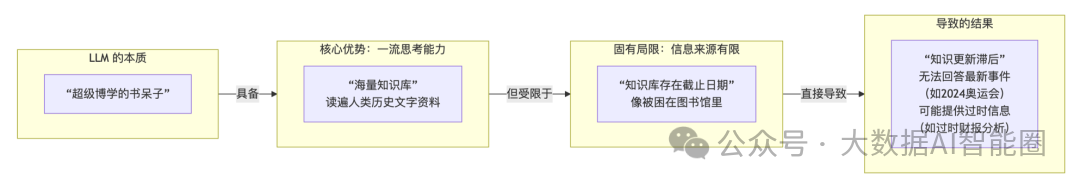

一、LLM:那个博学的书呆子

LLM,全称大语言模型,你可以把它想象成一个超级博学的书呆子。

这个书呆子有多厉害?它读遍了人类历史上几乎所有的文字资料,从莎士比亚的戏剧到最新的科学研究,从古代诗词到现代编程指南,什么都知道。

但是这个书呆子有个致命的弱点——它就像一个被困在图书馆里的人,知识更新永远跟不上时代。比如你问ChatGPT关于2024年奥运会的信息,它可能会给你一个不太准确的答案,因为它学习的资料总是滞后一段时间的。

我曾经测试过一个LLM,让它分析一家公司的最新财报。结果它给了我一个"专业"的分析,但当我查看那家公司的最新公告时,发现数据完全不匹配。这就像你问一个博学的教授今天股市怎么样,他给你的答案可能是昨天或者上周的信息。

这就是LLM的现状:思考能力一流,但信息来源有限。

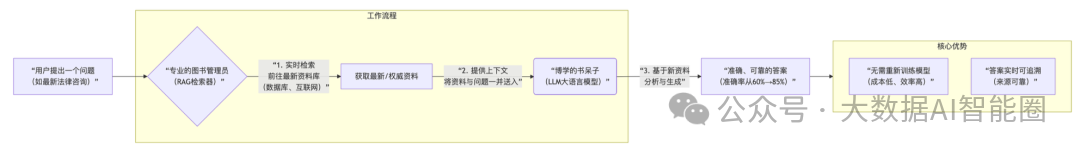

二、RAG:给书呆子配了个图书管理员

RAG技术的出现,就像是给这个博学的书呆子配了一个专业的图书管理员。

这个管理员的工作是什么?就是当有人问问题的时候,管理员会立即去最新的资料库里找相关的资料,然后把这些资料和书呆子一起关进小黑屋,让书呆子基于这些新资料来回答问题。

这个比喻其实很形象。原来的LLM就是一个人闭门造车,有了RAG之后,就变成了"先查资料,再回答"的模式。

我见过一个很好的RAG应用案例:一家法律科技公司用RAG技术做法律咨询。他们的LLM回答法律问题的准确率原本只有60%,加了RAG之后,准确率提升到了85%。

为什么?因为每次回答问题前,系统都会先检索最新的法条和案例,然后再让LLM基于这些资料来分析和回答。

RAG最厉害的地方在于,它让LLM变"聪明"了,但不需要重新训练整个模型。这好比给一个人配了百度百科+谷歌搜索外挂,想要什么最新信息,立即就能查到。

三、AI Agent:让书呆子变成能动手的行动派

如果说LLM是书呆子,RAG是图书管理员,那AI Agent就是一个能计划、会执行、善反思的行动派。

AI Agent的神奇之处在于,它不只是回答问题,而是能真的去帮你做事情。

比如你说"帮我订一张下周一去北京的机票",LLM可能告诉你"建议你提前订票,注意比较价格"之类的话,但AI Agent会真的去查询航班、价格,然后直接帮你下单。

这背后有一个复杂的工作流程:感知目标、分析需求、制定计划、调用工具、执行动作、查看结果、调整策略。

我见过一个做电商运营的AI Agent,它能自动分析店铺数据,发现某个产品销量下滑,然后分析原因,调整定价策略,最后还能生成一份分析报告给老板看。

这种能力已经超出了"回答问题"的范畴,而是变成了"解决问题"。

结语

有意思的是,真正的生产环境中,这三个"打工人"很少单独作战,它们往往要结合起来才能发挥最大威力。

LLM负责思考和推理,RAG负责提供准确的信息,AI Agent负责具体的执行。这就像一个完美的工作团队:聪明的头脑、丰富的信息源、强的执行力。

当然,这个过程也充满挑战。技术选型、数据质量、系统架构、用户体验,每一个环节都需要精心设计。但不管怎样,这代表着我们正在进入一个真正的AI时代——不是某个单一技术的炫技,而是多技术协同的智慧应用。

未来已来,只是分布不均。但当LLM、RAG、AI Agent三者真正协作起来时,这个"未来"就会变得更加触手可及。