来源(公众号):大数据AI智能圈

昨天和一个做传统制造业的老板聊天,他苦笑着说:"现在开会,年轻人张口就是'用LLM优化业务流程',我只能装懂点头,回头偷偷百度。"

这话听着熟悉吗? 在这个AI狂飙的时代,不懂这些"黑话",你就像拿着诺基亚走进了iPhone发布会。

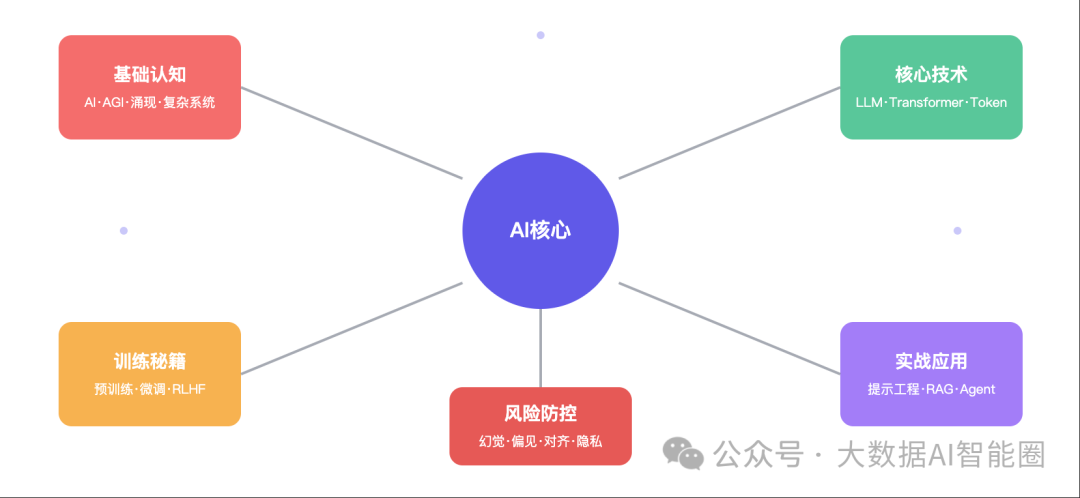

今天,我们就来破解

AI世界最核心的30个密码。

基础认知:AI的"底层逻辑"

人工智能(AI)说白了就是让机器干人类的活儿。你手机里的语音助手、购物网站的推荐系统,都是AI在默默工作。

通用人工智能(AGI)是AI的"终极形态"。现在的AI像专科医生,只会看一种病。AGI就是全科医生,什么都会,甚至比人类还厉害。

涌现能力特别神奇。就像一滴水没什么特别,但千万滴水聚在一起就能形成海啸。AI模型也是这样,参数达到某个临界点,突然就"开窍"了。

复杂系统听起来高深,其实就是"1+1>2"的道理。无数个简单组件组合起来,产生了意想不到的智能行为。

基础模型是AI界的"万金油",什么都能干一点,然后针对具体任务再"专业培训"。

核心技术:AI的"发动机"

大语言模型(LLM)是现在最火的AI技术。ChatGPT、Claude这些都是LLM,就像一个博览群书的学者,能理解你的话,给出靠谱回答。

Transformer架构是LLM的心脏。2017年谷歌的一篇论文改变了整个AI世界,让AI能像人类一样理解上下文。

自注意力机制让AI能"一心多用",同时关注文本中的所有重要信息,就像你读书时能联系前后文理解含义。

Token分词是AI理解语言的第一步,把连续的文字切成一个个"积木块",然后用这些积木搭建理解。

参数是AI的"记忆细胞",数量越多,AI越聪明,但也越"费电"。

上下文长度决定了AI的"记忆力",能记住多长的对话历史。

训练秘籍:如何"调教"AI

预训练就像给孩子上小学,先学基础知识。AI在海量文本上学习语言规律,打好基础。

微调是专业培训。基础打好后,针对具体工作进行"实习",比如客服、写作、编程。

RLHF(人类反馈强化学习)是AI的"家教"。人类给AI的回答打分,AI根据评价不断改进,就像学生根据老师批语提升作文水平。

少样本学习展现了AI的"举一反三"能力。只需要几个例子,就能理解新任务,这比传统机器学习厉害多了。

规模法则揭示了AI进步的"公式":更多数据+更大模型+更强算力=更聪明的AI。

实战应用:让AI为你打工

提示工程是和AI对话的艺术。同样的问题,不同问法效果天差地别。就像问路,"怎么走"和"从这里到天安门最快路线"得到的答案完全不同。

思维链让AI像人类一样"显示思考过程"。解题时不直接给答案,而是一步步推理,让你知道它是怎么想的。

RAG(检索增强生成)解决了AI"知识过时"的问题。回答前先查最新资料,就像开卷考试可以翻书。

向量数据库是AI的"图书馆",把所有信息转换成数字向量存储,支持语义搜索。

AI智能体(Agent)是AI的"高级形态",不只回答问题,还能主动执行任务,调用各种工具完成复杂工作。

性能评估:AI的"体检报告"

基准测试是AI的"高考",通过标准化考试评估AI在各方面的能力,比如MMLU、HumanEval等。

困惑度衡量AI对语言的理解程度,数值越低说明AI越"确定"自己的回答。

鲁棒性测试AI的"抗压能力",面对错别字、语法错误还能正常工作吗?

量化是AI的"减肥术",通过降低精度减少存储和计算需求,让大模型能在普通设备上运行。

延迟是AI响应速度,对实时应用特别重要。没人愿意等半天才得到回答。

风险防控:AI的"安全带"

幻觉是AI最大的毛病,会"一本正经地胡说八道"。就像那个自信满满但经常说错话的同事。

偏见让AI继承了人类的"坏习惯"。训练数据有偏见,AI自然也有偏见。

对齐确保AI按人类期望工作,不会"好心办坏事"。这比训练宠物还难。

红队测试是AI的"压力测试",专门找茬,看能不能让AI说出不该说的话。

可解释性AI让AI的决策过程变透明,不再是"黑盒子"。

数据隐私保护用户信息不被泄露,这在AI时代尤其重要。

结语

掌握这30个关键词,你就拥有了AI时代的"通行证"。不需要成为技术专家,但要理解这些概念,才能在AI浪潮中不掉队。

当然,AI不是来抢饭碗的,而是来当助手的。那些懂得与AI协作的人,将在未来占据先机。

现在,你还会被AI术语吓住吗?